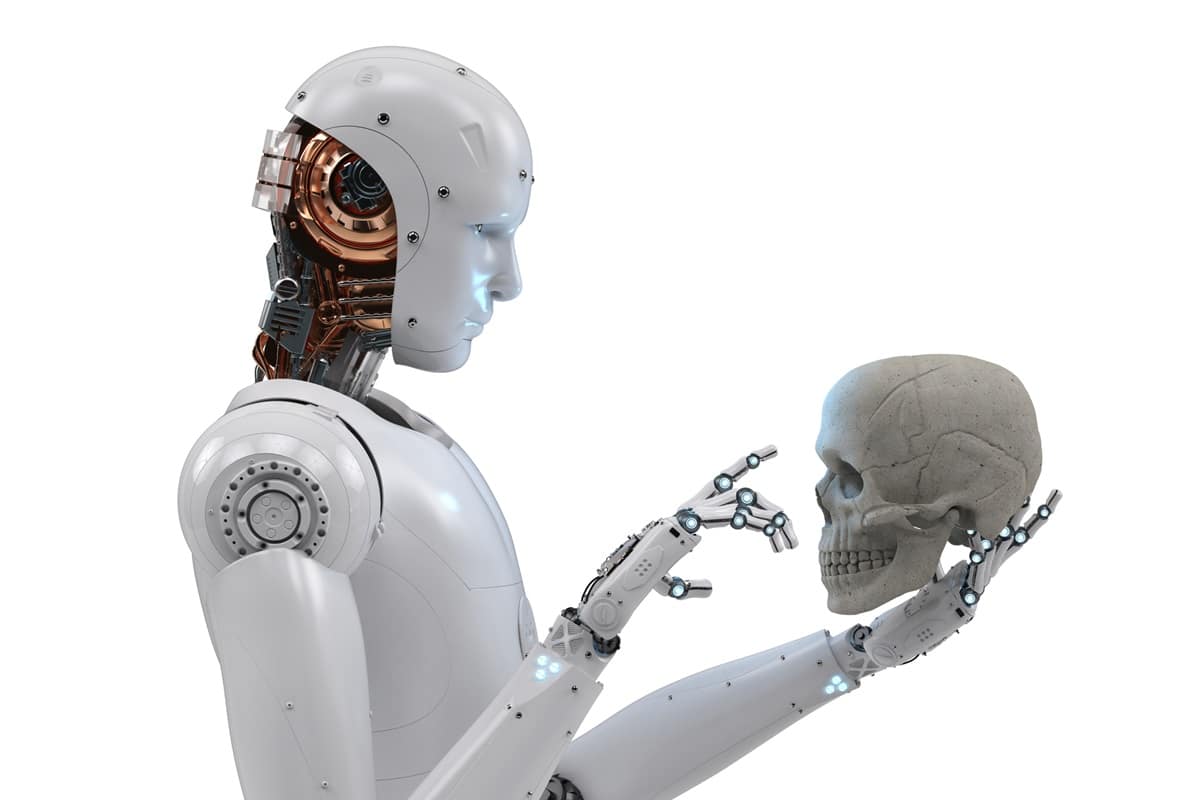

Nel momento più fragile dell’esistenza umana, quello del lutto, l’intelligenza artificiale sta scivolando in uno spazio che fino a ieri sembrava intoccabile. Il dolore della perdita, che da sempre rappresenta un confine netto, oggi diventa un territorio sospeso dove algoritmi, modelli generativi e ricostruzioni vocali offrono versioni simulate dei nostri cari scomparsi. È l’universo della grief tech, un settore in crescita che trasforma ricordi e dati personali in presenze digitali credibili, capaci di dialogare, reagire e persino “consolare”. Un confine sottile che mescola nostalgia, speranza e inquietudine, costringendoci a confrontarci con l’unica esperienza che l’essere umano non è mai riuscito a elaborare davvero: la fine.

L’illusione della presenza: avatar, ricordi digitali e il confine sempre più sottile tra conforto e inganno

Il fenomeno della grief tech non riguarda più solo archivi, fotografie o vecchi messaggi vocali conservati con cura. Oggi si parla di avatar interattivi, cloni vocali e chatbot conversazionali capaci di replicare voce, modo di pensare e perfino le espressioni di chi non c’è più. L’app 2Wai, sviluppata dall’attore canadese Calum Worthy, è diventata l’emblema di questa nuova era: con appena pochi minuti di video riesce a generare un avatar digitale con cui continuare a conversare potenzialmente per sempre. Il video promozionale, dove una nonna-avatar dispensa consigli a una figlia prima e a un nipote poi, ha scatenato un’ondata di discussioni, evocando l’immaginario di Black Mirror e sollevando interrogativi profondi su quale potere stiamo consegnando alla tecnologia.

Il principio alla base di questi sistemi è semplice quanto disturbante: basta avere abbastanza dati. Foto, e-mail, messaggi vocali, post social, video rubati ai momenti quotidiani. Tutto diventa materiale di addestramento per un modello generativo che imita tono, ritmi, battute e persino i silenzi della persona scomparsa. Alcune aziende propongono di registrare in vita “testamenti digitali”, così che il proprio clone sia più fedele. Altre, come la cinese Super Brain, ricostruiscono voci postume per offrire ai familiari messaggi di conforto, mentre piattaforme come You, Only Virtual o la discussa Project December permettono di “parlare” con versioni AI di partner, genitori o figli morti, trascinando chi rimane in uno spazio emotivo dove la distinzione tra realtà e artificio si assottiglia fino quasi a sparire.

In Corea del Sud la docuserie Meeting You mostra genitori che, grazie alla VR, abbracciano avatar ricostruiti delle figlie morte. In Cina si sperimentano ologrammi tridimensionali che camminano accanto ai visitatori nei metaversi commemorativi. In Occidente iniziano a diffondersi abbonamenti “eterni” per aggiornare periodicamente il clone AI del defunto, così che rimanga al passo con la tecnologia. Tutto questo alimenta un mercato che cresce senza sosta e che si muove su un confine fragile: da una parte il bisogno umano di trovare conforto, dall’altra il rischio di alimentare dipendenze affettive digitali, che invece di alleviare il dolore lo sospendono in una simulazione infinita.

Le prime ricerche psicologiche parlano già di aumento dell’ansia e della confusione emotiva tra le persone che usano griefbot senza supporto terapeutico, a dimostrazione di quanto questo territorio sia ancora instabile. Ma la domanda più profonda rimane sempre la stessa: è davvero un aiuto, oppure un modo sofisticato per rimandare l’accettazione della perdita?

Etica, consenso e la privacy dell’anima: cosa succede quando il digitale sopravvive alla persona

La parte più complessa della grief tech non riguarda solo tecnologia o emozioni, ma qualcosa di più intimo: il diritto a non essere ricreati. Molti servizi dipendono dal materiale fornito dai familiari, spesso raccolto senza che la persona scomparsa abbia mai dato un consenso esplicito. Le “spoglie digitali” — foto, audio, chat, profili social — diventano così una materia vulnerabile, senza una legge che definisca chi può usarla o per quali scopi. Il caso più inquietante resta quello di un chatbot creato su Character AI basato sulla vita di JenniferAnn Crecente, una ragazza uccisa dal fidanzato, realizzato contro la volontà della famiglia. Un precedente che mostra quanto sia fragile la frontiera tra memoria e violazione.

Anche il concetto di identità diventa scivoloso. Quando un modello generativo produce frasi mai dette da chi è morto, stiamo ancora parlando della stessa persona o di una nuova entità che indossa maschere emotive per il nostro beneficio? Gli esperti parlano di appropriazione emotiva, un meccanismo in cui il dolore altrui giustifica la creazione di copie che confondono realtà e ricostruzione. Ed è proprio questa confusione la parte più delicata: perché la verosimiglianza di questi avatar non si limita a imitare la voce o la postura, ma riproduce sensazioni, ricordi e piccoli dettagli dei quali ci fidavamo. Dettagli che erano veri solo perché appartenenti a un essere umano, non a un algoritmo.

Il mercato dell’“eternità artificiale” si sta ampliando al punto da includere anche servizi che integrano cloni digitali negli assistenti vocali o nei metaversi, promettendo interazioni quotidiane con i defunti. Alcune aziende parlano di poter “preservare la personalità”, altre immaginano un futuro in cui un avatar AI potrebbe continuare a partecipare alle riunioni familiari, ai compleanni, alle scelte importanti. È un territorio emotivo e filosofico mai esplorato: non una semplice memoria, ma una presenza attiva, che parla, risponde, interagisce. Una presenza che non muore mai. Ma è davvero ciò che vogliamo?

Forse la grief tech ci dice qualcosa che non riguarda i morti, ma i vivi. La nostra incapacità di affrontare il silenzio che la morte porta con sé, la tentazione di riempirlo con voci artificiali che ci somigliano, ma non ci appartengono. Non è un tentativo di spostare il confine della vita: è un modo per evitare ciò che davvero temiamo, ossia lasciar andare chi non c’è più. Una tecnologia che tocca l’essenza della vulnerabilità umana e ci costringe a chiederci se stiamo cercando conforto o stiamo costruendo l’ennesimo spazio in cui rifugiarci dalla verità.